RVMX AIによる画像生成(Stable_DiffusionをPC内で利用)の検証(参考)

RVMX AIによる画像生成(Stable_DiffusionをPC内で利用)の検証(参考)

概要 RVMX AIによる画像生成(Stable_DiffusionをPC内で利用)の検証(参考)

利用制限のない、PC内での利用の可能性を探るため検証します。

Stable_Diffusionは基本的にPythonの動作環境が必要となります。

1.動作環境検討

いろいろな方法があると思いますが、AIによる画像生成の可能性を確認するため下記の環境が考えられます。

基本機能はC#によるWindowsの画面より操作を予定しています。

一般的には高機能のGPU(画像作成に)が必要と言われていますが、できればそうでなくても動作できる環境を目指します。

-1.環境1

a.Pythonのインストール

b.Anaconda(Pythonの科学計算ツール)のインストール

c.Anaconda用のOpenCVのインストール

d.プロンプトの翻訳機能(予定)

検証でAnaconda用のOpenCVのインストールはできたが、実際に動作させるとOpenCVを認識しない?。(AnacondakスクリプトのImport cv2でエラー発生)そのため中断中

-2.環境2

GPUメーカーのNVIDIA製GPU利用環境作成

a.CUDA Toolキットのインストール

b.NVIDIA製GPUアクセレータのNVIDIA cuDNNのインストール

c.プロンプトの翻訳機能(予定)

これは高性能なNVIDIA製GPUが必要なため、中止します

-3.環境3(NcnnDotNetによるCPUのみで)

NcnnDotNetによるCPUのみで利用環境作成

c.プロンプトの翻訳機能(予定)

-4.環境4(WEB UIの利用)

WEB UI環境でStable_Diffusionを利用

完全なPC単独での利用ではない為、制限があるが比較的簡単に動作させることが可能

詳細は2.WEB UI環境でStable_Diffusionを利用で検証を参照

2.WEB UI環境でStable_Diffusionを利用で検証

-1.環境構築手順1

Stable Diffusion web UIの利用

a.Pythonポータブル版のダウンロード

b.Gitポータブル版のダウンロード

c.Pythonポータブル版の解凍(実行すれば自動解凍されます)

d.Gitポータブル版の解凍(実行すれば自動解凍されます)

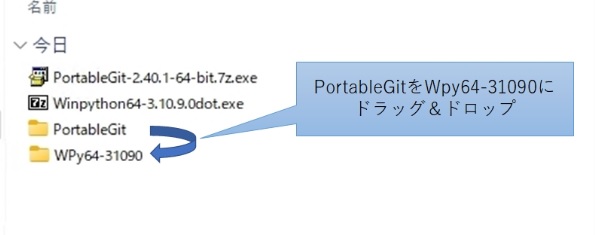

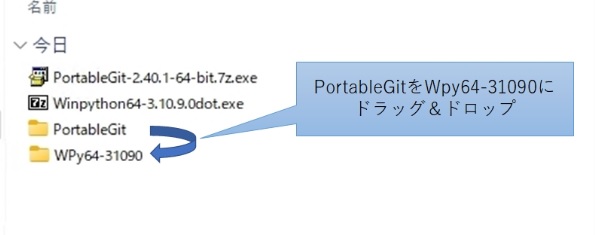

e.解凍後のGitポータブル版フォルダーをPythonポータブル版フォルダーへ移動

f.Pythonポータブル版フォルダーを分かりやすい任意のフォルダー名(StableDiffusionWebUI等)に変更

g.WinPython Command Prompt.exeを起動

コマンド

cd ..

portableGit\git-cmd

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git WebUIインストール

cd stable-diffusion-webui

webui.bat WebUI起動

AssertionError: Torch is not able to use GPU;”というエラーメッセージが出たとき

高性能なGPU(NVIDIA製)が必要と思われる。

GPUがCUDA TestをスキップとCPUですべてを処理追加

webui-user.batを開いて

set COMMANDLINE_ARGS=へ --use-cpu all --no-half --no-half-vae --skip-torch-cuda-testを追加

webui-user.bat起動

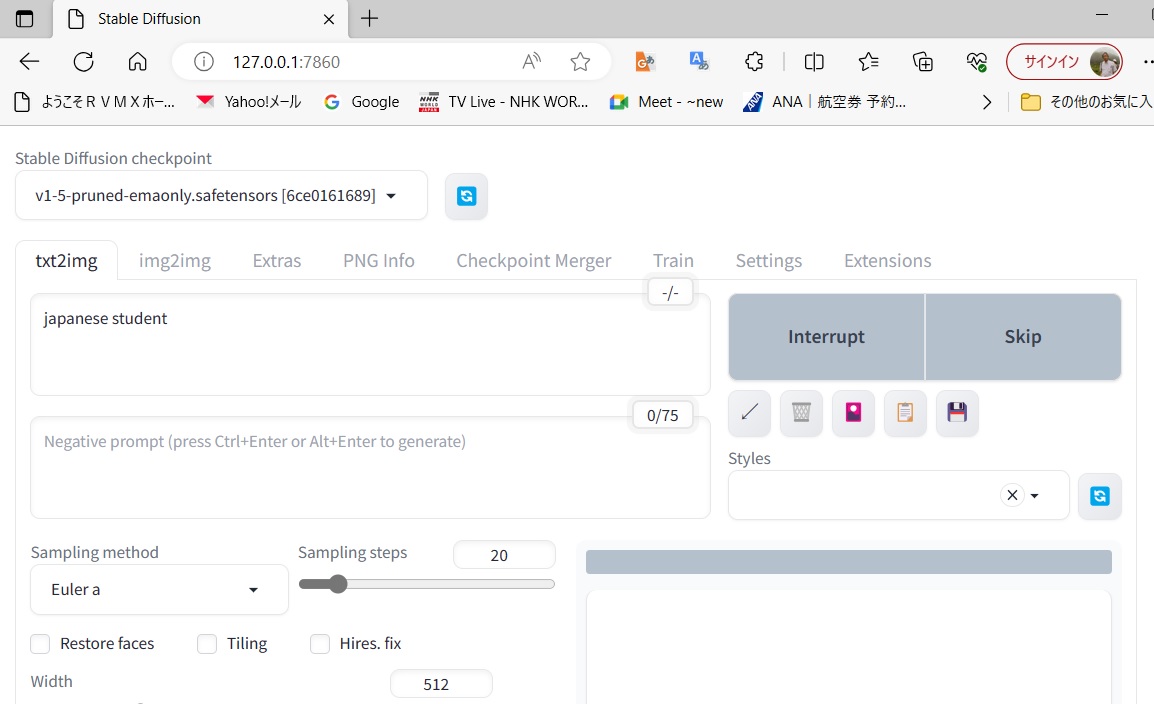

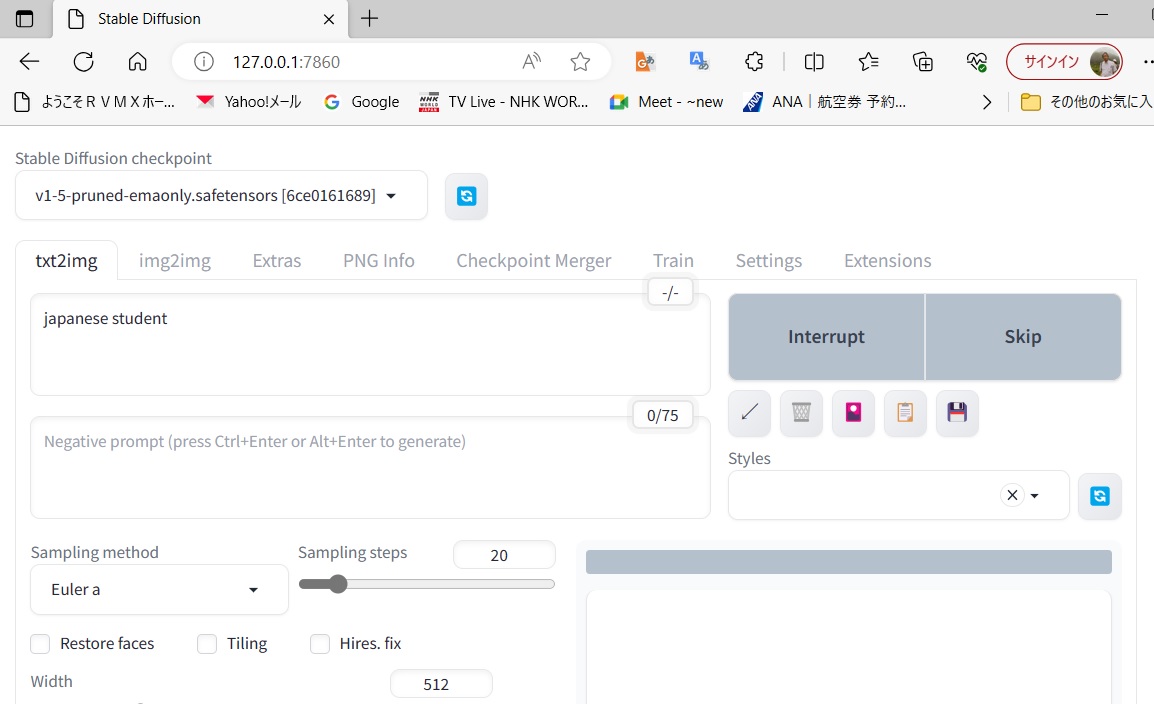

h.ブラウザよりhttp://127.0.0.1:7860で起動

i.Stable_Diffusion WebUIの画面は開いたが、japanese studentのプロンプトテストで動作するものの最終画像が表示されない

j.しかし、outputs内には結果画像ができている

-2.環境構築手順2(DirectML)

Stable Diffusion web UI with DirectMLの利用

a.GitのダウンロードとGitのインストール

注意:Windows Explorer InterrationのGit Bashにチェック

b.Miniconda(Anacondaの小型版)の取得とGitのインストール

注意:Add Miniconda3 to my PATH environment variable にチェックを入れる。

c.学習データ(sd-v1-4.ckpt)の取得

d.stable-diffusion-webui-directmlの取得

e.stable-diffusion-webui-directml\models\Stable-diffusionへsd-v1-4.ckptをコピー

f.webui-user.batをダブルクリックしインストールを開始(不明なソフトとして警告が出ることもある)

g.ブラウザよりhttp://127.0.0.1:7860で起動

h.Stable_Diffusion WebUIの画面は開いたが、japanese studentのプロンプトテストで画像が作成できない(Intel GPUの為か)

-3.環境構築手順2(Intel GPU)

https://zenn.dev/asopitech/articles/20230610-193214_1

a.Pythonポータブル版のダウンロード

-4.環境構築手順2(by CPU)

https://medium.com/openvino-toolkit/how-to-run-stable-diffusion-on-intel-gpus-with-openvino-840714f122b4

How to run Stable Diffusion on Intel GPUs with OpenVINO

3.その他

-1.現在開発中です。

3.AI関連リンク

-1.RVMX AI関連 News

-2.RVMX AIによるテキストより画像生成検証Tool(参考)

-3.RVMX AIによるテキストより画像生成用プロンプト作成補助Tool(参考)

-4.RVMX AIによるテキスト生成検証Tool(参考)

提供ソフトのQ&A

(有)RVMX